| この記事でわかること |

|

|---|---|

| この記事の対象者 |

|

| 効率化できる業務 |

|

「AIを業務に導入したい! ベンダーも決まった! さあ開発だ!」 ……と、勢いよく走り出そうとした矢先、法務部から「この契約書、リスクが高すぎませんか?」とストップがかかる。

あるいは逆に、とりあえずいつもの業務委託契約書の雛形でサインしてしまい、後になって「えっ、入力した顧客データ、AIの学習に使われちゃうの!?」と顔面蒼白になる。

これ、今の日本の企業の現場で毎日のように起きている光景です。あなたも心当たりがありませんか?

AI、特に生成AIの進化は爆発的ですが、それを縛る「契約」の世界は、これまでずっとグレーゾーンだらけでした。従来のシステム開発と同じ感覚でいると、痛い目を見ます。なぜなら、AIは「仕様通りに作れば動く」ものではなく、「確率的に答えを出す、生き物のようなシステム」だからです。

そんな混乱する現場に、ついに助け船が出ました。 2025年2月18日、経済産業省が「AIの利用・開発に関する契約チェックリスト」を公開したのです。

今回は、この最新ニュースを元に、AI導入を成功させるためにDX担当者や経営企画担当者が「絶対に押さえておくべき契約の急所」を、専門用語をできるだけ使わずに解説します。「契約書は苦手……」という方も、これだけ読めば法務担当者と対等に会話できるようになりますよ。

なぜ「普通の業務委託契約」ではAI導入に失敗するのか

まず前提として、なぜAI開発やAI導入において、これまでの「システム開発契約」や「SaaS利用規約」ではうまくいかないのでしょうか? その理由は、AIという技術の特殊性にあります。

「100%の完成品」は存在しない

従来のシステム開発(ウォーターフォール型など)では、発注側が「こういう機能が欲しい」と仕様を決め、ベンダーがその通りに作ります。納品されたものが仕様通りでなければ「バグ(瑕疵)」として修正を求めることができます。

しかし、AIは違います。 「精度90%を目指しましたが、やってみたら85%でした」ということが平気で起こります。しかも、昨日正しかった答えが、今日の入力データでは間違っているかもしれない。これを従来の契約書で「瑕疵(欠陥)だから無料で直せ」と言うと、ベンダー側は「いや、それはAIの性質上無理です」と反論し、泥沼の争いになります。

データは誰のもの?「学習」という新たな壁

もう一つの大きな問題は「データ」です。 従来なら、預けたデータは処理されて戻ってくるだけでした。しかしAIの場合、「預けたデータを使ってAIが賢くなる(学習する)」というプロセスが発生する可能性があります。

もし、あなたが競合他社には絶対知られたくない「独自の製造ノウハウ」をAIに入力し、それがAIベンダーのモデルの学習に使われてしまったら? そのAIを競合他社が使ったとき、あなたのノウハウが間接的に流出してしまうかもしれません。

こうした「AI特有のリスク」に対応するためには、これまでの契約書の雛形をそのまま使うのはあまりに危険なのです。

2025年2月公開!経産省「AI契約チェックリスト」の正体

そこで登場したのが、経済産業省による「AIの利用・開発に関する契約チェックリスト」です。

これは、2018年に策定されたガイドラインをベースにしつつ、近年の生成AIブームや実務の混乱を受けて、より具体的で使いやすくアップデートされたものです。特に、「AIの専門家ではない中小企業や非テック企業の担当者」でも使えるように設計されているのが嬉しいポイントです。

どんな人が読むべき?

- 社内のDX推進担当者

- 法務部がない(またはITに詳しくない)企業の経営者

- AIベンダーとこれから契約を結ぼうとしている担当者

- 「ChatGPT Enterprise」や「Microsoft Copilot」などの導入を検討中の情シス

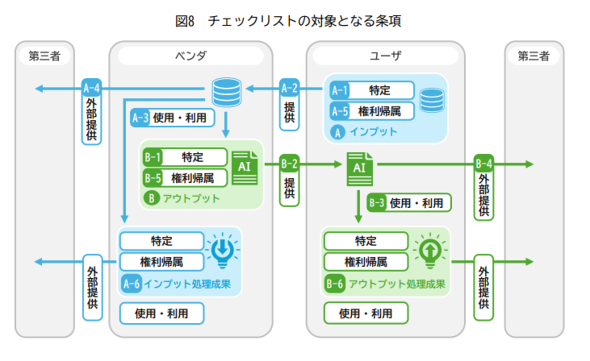

このチェックリストの3つの対象領域

経産省は、AI契約を大きく3つのパターンに分けて解説しています。自分がどれに当てはまるか確認してみてください。

- 汎用的AIサービス利用型(SaaS型)

- ChatGPT、Gemini、Claude、その他AI機能付きのSaaSなどを契約して使うパターン。

- ここが重要: 多くの企業はこれに該当します。利用規約を「同意する」ボタンで済ませがちですが、一番リスクが潜んでいるのもここです。

- カスタマイズ型

- 既存のAIモデルをベースに、自社データを入れて微調整(ファインチューニングやRAG構築)をしてもらうパターン。

- ここが重要: ベンダーとの共同作業になります。「追加学習させた部分の権利はどっちのもの?」で揉めがちです。

- 新規開発型

- ゼロからAIモデルを開発するパターン。

- ここが重要: コストもリスクも最大級。詳細な契約書が必須です。

今回のチェックリストは、これら全てのパターンにおいて「ここだけはチェックしておけ!」というポイントを網羅しています。

ここだけは譲れない!契約交渉の3大防衛ライン

チェックリストは非常に詳細ですが、全部を完璧に理解するのは大変です。 ここでは、現場の担当者が「ここを見落とすと致命傷になる」という3つの防衛ラインに絞って解説します。法務担当者にレビューを依頼する際も、この3点を重点的に伝えてください。

防衛ライン①:入力データの「学習利用」を許諾するか?

これが最大の争点です。 あなたがAIに入力するデータ(プロンプトやアップロードするファイル)を、ベンダーが「自社のAIモデルの精度向上のために利用してもよいか」という条項です。

- ベンダー側の言い分: 「たくさんのデータで学習させることで、AIは賢くなります。あなたのデータを使うことで、将来的にあなたにとってもより良いサービスを提供できます。」

- ユーザー側の言い分: 「冗談じゃない。うちの顧客リストや特許前の技術情報を、ライバルも使うかもしれないAIの学習材料にするなんてありえない。」

【対策】 多くの汎用AIサービス(SaaS)では、デフォルトで「学習に利用する」設定になっていることがあります。

- 契約書(利用規約)の確認: 「サービス改善のために利用する」といった文言がないかチェックしてください。

- オプトアウト申請: 学習に使わせないための設定(オプトアウト)や、法人向けプラン(Enterprise版など)への切り替えを検討しましょう。法人プランでは「学習利用しない」と明記されていることが多いです。

防衛ライン②:出力(成果物)の権利は誰のもの?

AIが生成した文章、画像、あるいはプログラムコード。これらの著作権や特許権は、ユーザー(発注者)のものになるのか、ベンダー(開発者・サービス提供者)のものになるのか?

- 新規開発・カスタマイズの場合: ベンダーは「AIモデル自体の権利」は渡したがりませんが、「そのAIが生み出した成果物」の利用権はユーザーに渡すのが一般的です。しかし、契約書によっては「成果物の権利もベンダーに帰属し、ユーザーは利用許諾を得るだけ」となっている場合もあります。

- SaaS利用の場合: 例えば画像生成AIで作ったキャラクターを自社の広告に使いたい場合、商用利用が可能かどうか、著作権がユーザーに発生するのかは、プラットフォームの規約次第です。

【対策】 「成果物を利用できる範囲」を明確にしましょう。自社だけで独占的に使いたいのか、他社に使われてもいいのか。ここが曖昧だと、後で「追加ライセンス料」を請求されるリスクがあります。

防衛ライン③:AIが「嘘」をついた時の責任(保証・賠償)

生成AIは「ハルシネーション(もっともらしい嘘)」をつくことがあります。また、AIが生成した画像が、偶然誰かの著作権を侵害してしまう(既存のイラストに激似してしまう)可能性もゼロではありません。

- 問い: AIが作った回答を信じて業務を行い、損害が出た場合、ベンダーは責任を取ってくれるのか?

- 現実: 多くのAIサービス契約では「現状有姿(As-Is)」での提供、つまり「保証はしないし、責任も負わない」という条項が入っています。

【対策】 SaaS型の場合、この免責条項を受け入れざるを得ないケースがほとんどです。そのため、契約で縛るというよりは、「AIの出力は必ず人間がチェックする」という社内運用ルールでリスクカバーする必要があります。 一方、受託開発(カスタマイズ型)の場合は、「一定の精度が出なかった場合の検収拒否」や「第三者の権利侵害時の補償(IP補償)」を契約に盛り込めるか交渉の余地があります。

【ケーススタディ】契約書の落とし穴にはまった企業の末路

「まあ、大手ベンダーだし大丈夫だろう」 そんな油断が招いた、架空の(しかし現実にありえる)失敗事例を見てみましょう。

事例A:機密情報がダダ漏れ? SaaS契約の罠

中堅メーカーのA社は、業務効率化のために話題の文章生成AIサービスを導入しました。担当者は無料版のアカウントを作成し、利用規約を斜め読みして「同意」ボタンをクリック。開発部のエンジニアたちは、新製品の設計図や会議の議事録を次々とAIに入力し、要約やアイデア出しに使っていました。

数ヶ月後、そのAIサービスを提供しているベンダーから、「最新モデルの性能向上」のアナウンスがありました。しかし、SNS上で「このAI、ある特定の質問をすると、A社の新製品っぽい情報を詳しく答えてくるぞ?」という噂が広まりました。

【原因】 A社が使っていた無料プランの規約には、「入力データはAIの学習・改善に使用される」と明記されていました。A社の機密情報は、世界中のユーザーが使うAIの「知識」の一部になってしまっていたのです。

※これは極端な例ですが、学習データへの混入リスクは常に意識する必要があります。

事例B:追加費用地獄のカスタマイズ開発

B社は、自社の過去の営業日報を学習させた「営業アドバイスAI」の開発をベンダーに依頼しました。「営業マンが相談すると、過去の成功事例から最適な回答をくれるAI」という夢のような企画です。

しかし、納品されたAIは、まともな回答をしませんでした。「頑張りましょう」「お客様に電話しましょう」といった当たり前のことしか言わないのです。B社は「これじゃ使えない。直してくれ」と言いましたが、ベンダーは言いました。 「契約書には『学習モデルの提供』としか書いてありません。精度保証の条項はありませんので、修正には追加費用がかかります」

【原因】 AI開発における「完成」の定義をあいまいにしていたことが原因です。従来のシステムのように「仕様通り=完成」ではなく、「PoC(概念実証)段階で精度目標を握る」「精度が満たない場合の撤退ラインを決める」といった、AI特有の契約プロセス踏んでいなかったため、B社は高額な勉強代を払うことになりました。

よくある質問(FAQ):AI契約の「困った」を解決

ここで、経産省のチェックリストやガイドラインに関連して、現場からよく出る質問にお答えします。

Q1. ChatGPTのようなSaaS利用でも、いちいち契約書(利用規約)を確認すべきですか?

A. 絶対にすべきです。 特に「入力データの学習利用(オプトアウト)」と「著作権の帰属」は必須チェック項目です。また、個人情報を入力する場合は、個人情報保護法上の「第三者提供」や「委託」に該当するかどうかの整理も必要になります。法務部門に「このサービスの規約、学習利用の条項どうなってますか?」と聞くだけでもリスクは大幅に減ります。

Q2. 過去のシステム開発契約書の雛形を使い回してもいいですか?

A. おすすめしません。 先述の通り、従来の契約書には「学習データ利用」や「ハルシネーションリスク」の観点が抜けています。また、AIモデルの権利帰属についても不明確になりがちです。今回の経産省チェックリストを参考に、AI特有の条項(特約)を追加することをお勧めします。

Q3. ベンダーから「AIの精度は保証できません」と言われました。契約すべきではない?

A. それだけで「No」ではありません。 むしろ、誠実なベンダーほど安易に「100%保証します」とは言いません。重要なのは、「保証できないリスク」をどうコントロールするかです。「段階的に開発を進める(アジャイル型)」「PoCで精度を確認してから本開発に進む契約にする」など、リスクを分散させる契約形態を相談しましょう。

まとめ:AIを「安全に」使い倒すための第一歩

AI導入は、企業にとって大きな武器になります。しかし、武器の扱い方を間違えれば、自分自身を傷つけることになります。その「取扱説明書」こそが契約書です。

2025年2月に経産省が出したチェックリストは、決して「AI導入を難しくするためのもの」ではありません。むしろ、「ここさえ気をつけておけば、あとは自由にやっていいよ」という安全地帯を示してくれる地図です。

明日からできるアクションプラン

- チェックリストのダウンロード まずは経済産業省のサイトから「AIの利用・開発に関する契約チェックリスト」をダウンロードしてください。

- 法務・知財担当者への共有 「これ、今のうちのAI導入プロジェクトに関係しそうです」と、この記事のURLと一緒にチャットで送ってみてください。きっと感謝されます(あるいは「やっと気づいてくれたか!」と言われるかもしれません)。

- 「AIはパートナー」という意識変革 契約書ガチガチで縛るのではなく、「不確実なものを一緒に育てていく」ためのルール作りという意識で、ベンダーとの対話を進めてください。

AI時代において、「良い契約」は「良いAI」を作るための土台です。 面倒くさがらず、最初の一歩を踏み出してみましょう。それが、あなたの会社の未来を守り、加速させることにつながります。

参考

経済産業省「「AIの利用・開発に関する契約チェックリスト」を取りまとめました」