| この記事でわかること |

|

| この記事の対象者 |

|

| 効率化できる業務 |

|

「今あなたが見ているこの記事、AIが書いたものかもしれません」

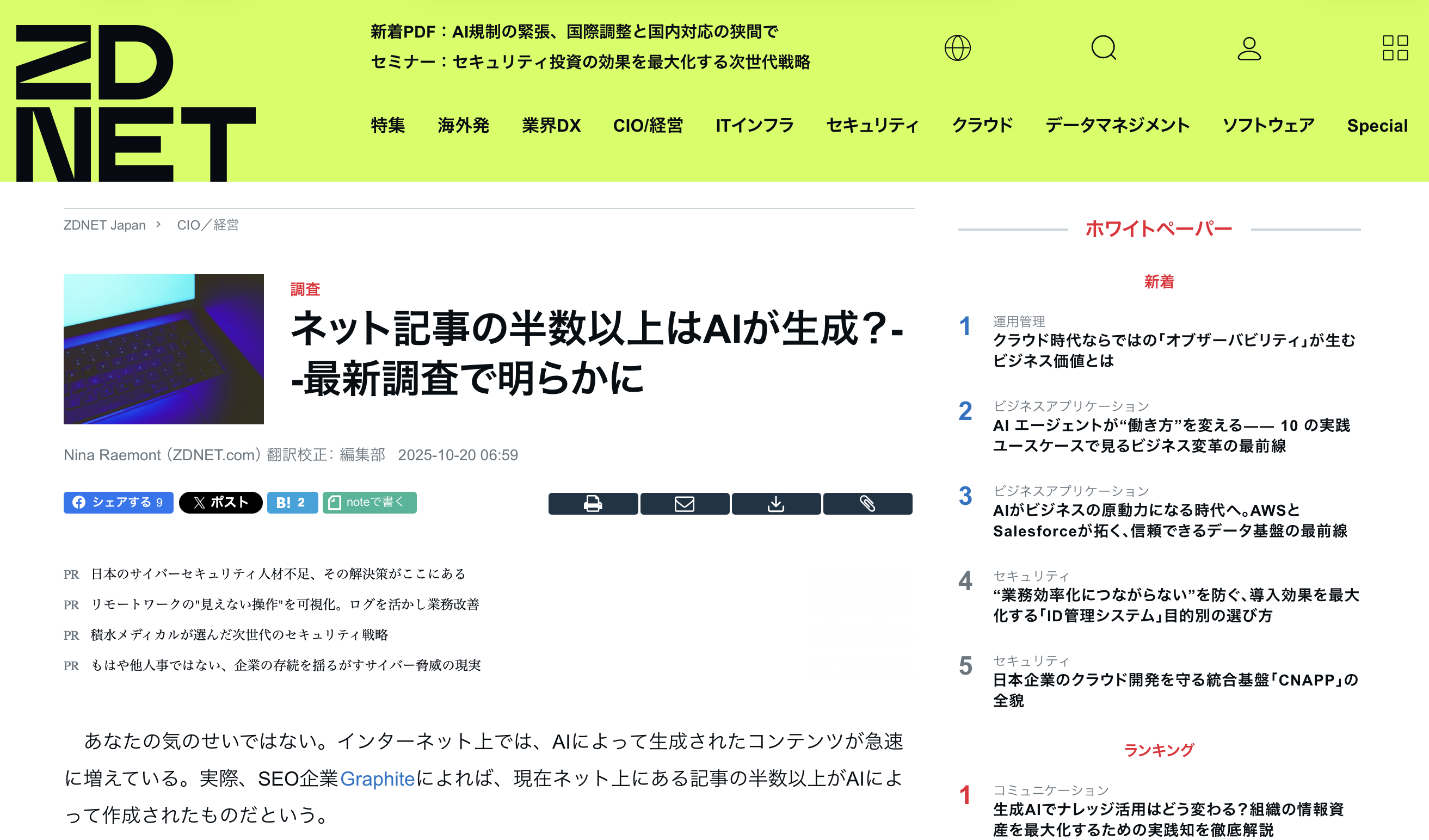

こう言われて、驚く人はもはや少数派になりつつあるのでしょうか。ZDNet Japanが報じたある最新の調査結果が、業界に衝撃を与えています。

「ネット記事の実に55%が、AIによって生成されている」

この数字、あなたはどう受け止めますか? 「思ったより多い」と感じたでしょうか、それとも「そんなものだろう」と納得したでしょうか。

私たち企業の経営企画、DX推進、あるいは人事や情報システム部門担当者にとって、これは単なる「トレンド」では済まされない、事業の根幹に関わる大きな転換点です。

この記事では、この「55%」という数字の裏側にある実態を解き明かし、企業がAI生成コンテンツという荒波とどう向き合い、どう活用していくべきか、その羅針盤を示します。

この記事を読み終える頃には、あなたは以下の3点を手に入れているはずです。

- AIコンテンツ普及の「正確な実態」と「背景」

- AI生成記事に潜む「法務・SEO・信用の3大リスク」を回避する方法

- AIを「脅威」ではなく「強力な副操縦士」として活用する戦略

ZDNet Japan発:最新調査が示すAIコンテンツの普及率

今回注目を集めているのは、AIコンテンツ検出ツールを提供するOriginality.aiが発表した調査結果です。彼らの分析によると、2024年初頭から2025年にかけて、ウェブ上でAIによって生成されたと見られるコンテンツの割合が急増し、全体の過半数である55%に達したというのです。

これは、特定の業界に限った話ではありません。ブログ、ニュース記事、商品レビューなど、私たちが日常的に触れるあらゆるテキストコンテンツで、「AIの手」が加わっている可能性が半分以上ある、ということを示唆しています。

この背景には、もちろんChatGPTやGeminiといった高性能な生成AIが、誰でも簡単に、かつ安価に利用できるようになったことが挙げられます。しかし、この数字は私たちに「効率化」というメリットと同時に、「品質の低下」や「情報の均質化」という深刻な問いも投げかけています。

国内の利用実態:企業の導入率と個人の利用経験

では、日本国内の状況はどうでしょうか。この「55%」というグローバルな(あるいは英語圏中心の)調査結果と、私たちの実感には少し差があるかもしれません。

複数の国内調査を見てみると、実態は「急速な普及期に入った段階」と言えそうです。

- 企業利用の実態: 矢野経済研究所の2025年2月時点の調査によれば、国内企業における生成AIの利用率は25.8%(「全社的活用」4.0%、「一部部署で活用」21.8%)でした。これは前年の調査(2024年2月)の9.9%から僅か1年で約2.6倍に増加しており、驚異的なスピードで企業導入が進んでいることがわかります。

- 個人利用の実態: 個人の利用も急速に広がっています。ICT総研の調査(2024年末時点)では、日本のネットユーザーのうち直近1年以内に生成AIサービスを利用した人は29%に上りました。また、メディアリーチ社が2025年5月に行った調査では、特に10代・20代の若年層において「週1回以上利用する」と回答した人が5割前後に達しています。

これらのデータから、日本は今まさに「AI活用が一部のアーリーアダプターから、企業活動や日常生活のメインストリームへと移行する」過渡期にあることが鮮明に浮かび上がります。世界的な「55%」という数字は、数年後の日本の姿を映しているのかもしれません。

なぜAI生成記事は急速に増えたのか?その背景と動機

これほどのスピードでAI生成記事がウェブを席巻している背景には、大きく分けて3つの動機が存在します。

コンテンツ制作の「効率化」という魅力

最大の理由は、言うまでもなく「圧倒的な生産性」です。

これまで1本の記事を書き上げるのに数時間、あるいは数日かかっていた作業が、AIを使えば数分で「下書き」が完成してしまいます。企業のオウンドメディア運営、マーケティングコンテンツの作成、日々のプレスリリース配信など、あらゆる場面でこの効率化は魅力的です。

企画担当者やDX推進部にとって、AIは「コンテンツ制作コストの大幅な削減」と「施策スピードの劇的な向上」を同時に実現する魔法の杖のように映っています。

事実、海外のBtoB SaaS企業Workfellow社は、AIを活用したSEO戦略により、わずか1年でオーガニック検索トラフィック(広告費をかけない自然な検索流入)を22倍に伸ばしたと報告しています。これは、AIを「事業成長ドライバー」として戦略的に活用した好例と言えるでしょう。

SEO目的の大量生産という課題

一方で、ネガティブな動機も存在します。それが「SEO(検索エンジン最適化)」目的でのコンテンツ大量生産です。

かつての検索エンジン対策では、「記事の量」が一定の評価を持っていた時代がありました。その名残で、「とにかくAIで大量の記事を生成し、検索流入の“数撃ちゃ当たる”を狙う」という、品質を度外視した手法が一部で横行しているのも事実です。

これらのコンテンツは、多くの場合、ウェブ上の既存情報を表面的になぞっただけで、読者にとって何の新しい価値ももたらしません。

AI技術の進化とアクセシビリティ向上

そして根本的な理由として、AI自体の性能が飛躍的に向上し、かつ利用コストが劇的に下がったことが挙げられます。

数年前までのAIが書く文章は、どこかぎこちなく、すぐに「機械が書いた」とわかるものでした。しかし、現代のGPT-4oやGemini 1.5 Proなどが生成するテキストは、非常に自然で、人間が書いたものと見分けがつかないレベルに達しています。

この「質の向上」と「低コスト化」が、プロの現場から個人の副業まで、あらゆる層でのAIライティング活用を一気に加速させたのです。

AI生成コンテンツに潜む3大リスク|企業担当者の必須知識

AIによる効率化は魅力的ですが、経営企画部や情シス部、人事部が目を光らせなければならない重大なリスクが3つ存在します。これを見過ごすと、企業の信用や事業そのものに深刻なダメージを与えかねません。

リスク1:ハルシネーション(嘘)と炎上リスク

生成AIは、学習したデータに基づき「もっともらしい」文章を生成しますが、それが「事実」であるとは限りません。AIが平然と嘘の情報を生成する現象は「ハルシネーション(幻覚)」と呼ばれています。

もし、企業が発信するオウンドメディアの記事やプレスリリースに、このハルシネーションによる誤情報が含まれていたらどうなるでしょうか?

「新製品のスペックが間違っていた」「存在しない法律を引用していた」「競合他社に関する虚偽の情報を記載していた」――。これらが発覚すれば、SNSでの炎上、顧客からの信頼失墜、株価への影響など、取り返しのつかない事態に発展する可能性があります。

リスク2:著作権・プライバシー侵害の可能性

AIは、インターネット上の膨大なテキストデータを学習しています。その中には、当然、著作権で保護された記事や論文、個人のブログ記事なども含まれます。

AIが生成した文章が、意図せず既存の著作物と酷似してしまう「盗用」のリスクは常に存在します。また、学習データに含まれていた個人情報や企業の機密情報を、AIがうっかり「生成」してしまう可能性もゼロではありません。

法務部門や情報システム部門は、AIの利用が自社のコンプライアンス体制に穴を開けないか、細心の注意を払う必要があります。

リスク3:Googleの評価下落(Helpful Content Update)

「AIで記事を量産すればSEOに強い」――これは、もはや過去の幻想です。

Googleは、「ユーザーの役に立つ、人間中心のコンテンツ」を高く評価する「Helpful Content Update(ヘルプフルコンテンツアップデート)」をコアアルゴリズムに組み込んでいます。

Googleの公式見解は、「AIによる生成かどうか」を問題にしているのではなく、「そのコンテンツがユーザーにとって価値があるか」を最重要視するというものです。

つまり、AIを使って生成したとしても、それが独自性のない、どこにでもあるような薄っぺらい内容であれば、Googleからの評価は下がり、検索順位は圏外に飛ばされるリスクがあります。

さらに、Googleが導入を進める「AI Overview」(検索結果の最上部に表示されるAIの要約)時代において、このリスクはより深刻になります。品質の低いAIコンテンツは、AI Overviewの「引用元」として選ばれにくくなります。結果として、たとえ検索順位が(従来の青いリンク部分で)上位であっても、ユーザーの目には触れずクリックされない「ゼロクリック検索」が増加し、サイトへの流入が激減する恐れがあるのです。

効率化を求めた結果、オウンドメディア全体の評価が下落してしまっては本末転倒です。

その記事、AI製?人間の目とツールによる「見分け方」

リスクを回避するためには、まず「AIが生成したコンテンツ」を見分ける能力が必要です。DX推進部やメディア担当者は、以下の視点を持つことが推奨されます。

人間の目で見抜くポイント(不自然な表現、画像の違和感)

AIの文章は流暢になりましたが、まだ「癖」が残っています。

- 無難で表面的な内容:独自の見解や深い洞察がなく、一般論や当たり障りのない記述に終始しがちです。

- 過剰に整然とした論理:あまりに「起承転結」が整いすぎて、人間の文章特有の「揺らぎ」や「熱量」が感じられないことがあります。

- 特定のフレーズの多用:「しかしながら」「一方で」「〜と言えるでしょう」といった接続詞や文末表現が不自然に繰り返される傾向があります。

- 画像の違和感(AI生成画像の場合):AIが生成した画像は、一見リアルでも細部に破綻が出やすいです。「指が6本ある」「背景の看板の文字が読めない」「光の当たり方が不自然」などは、典型的なAI生成のサインです。

AIコンテンツ検出ツールの活用法と限界

人間の目だけでなく、専用のツールを使う方法もあります。「Writer」や「Crossplag」、「AI Or Not」といったAIコンテンツ検出ツールは、テキストを貼り付けるだけで、AIが生成した可能性をパーセンテージで示してくれます。

これらは、外部から納品された記事の一次チェックや、競合サイトの分析に役立ちます。

ただし、これらのツールも万能ではありません。AIの進化は検出ツールの進化を常に上回ろうとしており、人間が巧妙に編集したAI記事や、最新のAIモデルが生成した記事は検出をすり抜ける可能性があります。あくまで「補助的な判断材料」と捉えるべきです。

「AI生成」の明示義務と透明性の重要性

見分ける努力と同時に、企業側が「透明性」を持つことも重要です。Googleは、「AIがどのように使われたか」を読者に示すことが、信頼性(E-E-A-T)の観点から有益であると示唆しています。

例えば、記事の末尾に「この記事はAIによる下書きを基に、専門家が監修・編集しました」といった注記を入れることは、読者に対する誠実な態度であり、長期的な信頼構築に繋がります。

AIを「脅威」から「強力な武器」へ変える活用戦略

「55%」という数字や「3大リスク」を前に、「AIは禁止すべきか?」と考えるのは早計です。日本のAI活用効果が他国に比べて低いという調査結果もある中、重要なのは「どう賢く使うか」です。

失敗例:AIに丸投げしたコンテンツの末路

最も安易で、最も危険なのが「AIに丸投げ」する運用です。

- AIにキーワードだけを与え、生成されたテキストをそのまま公開する。

- ファクトチェック(事実確認)や編集を一切行わない。

- SEO目的で、似たような記事を毎日大量に投稿する。

このような運用は、前述の「ハルシネーション」や「著作権侵害」のリスクを最大化させます。さらに、Googleのヘルプフルコンテンツシステムによって「低品質なサイト」と見なされ、サイト全体の検索順位が下落する最悪のシナリオを招きます。

成功例:AIを「副操縦士」として活用しE-E-A-Tを高める方法

成功する企業は、AIを「自動操縦士」ではなく、優秀な「副操縦士(コ・パイロット)」として扱います。

Googleが重視する品質基準「E-E-A-T」(Experience: 経験, Expertise: 専門性, Authoritativeness: 権威性, Trustworthiness: 信頼性)こそが、AI活用の鍵です。

AIは、一般的な情報や基本的な構成案(Expertiseの一部)を作るのは得意です。しかし、AIには「独自の体験談(Experience)」や「現場の深い知見(Expertiseの核心)」、「業界内の権威(Authoritativeness)」はありません。

成功する運用とは、以下のようなプロセスです。

- AIによる「骨子作成」: AIにテーマを伝え、記事の構成案と基本的な説明文(下書き)を生成させます。

- 人間による「魂の注入」: ここからが人間の仕事です。

- 経験 (Experience): 自社で実際にあった成功事例、失敗談、顧客の声といった「一次情報」を追記します。

- 専門性 (Expertise): 社内の専門家(例えば、情シス部ならエンジニア、人事部なら労務担当者)が、AIの一般的な記述を、より深く、正確な専門的知見で修正・加筆します。

- 信頼性 (Trust): 著者名や監修者名を明記し、「誰が」その情報の責任を持っているかを明確にします。

この「誰が、どのように、なぜ作成したか (Who/How/Why)」を読者に開示することは、Googleが提唱する「信頼できるコンテンツ」の作成方法とも合致します。

例えば、「この記事は、最新のAIトレンドに関する下書きをAIで作成し、弊社のDXコンサルタントである〇〇が、日本企業の実態に合わせて監修・加筆しました。企業のDX推進担当者の皆さまが具体的なリスクと対策を理解するために作成しています」といった透明性の高いプロフィールを提示することが、AI時代の「信頼性」構築に繋がります。

AIが作った「骨格」に、人間が「血肉」と「魂」を通わせる。このハイブリッドな運用こそが、Googleにも読者にも評価される高品質コンテンツを生み出す唯一の方法です。

企業が今すぐ整備すべき「AI利用ガイドライン」の要点

AIの活用を「個人の裁量」に任せておくのは非常に危険です。情シス部門や人事部門は、経営企画と連携し、全社的な「AI利用ガイドライン」を早急に策定・周知する必要があります。

最低限、以下の項目は盛り込むべきです。

- 目的の明確化: AIを「効率化」と「品質向上」のために使うことを定義する。

- 入力禁止情報の定義: 機密情報、個人情報、顧客データをAIに入力することを厳禁とする。

- ファクトチェックの義務化: AIの生成物は、必ず人間が事実確認を行うプロセスを定める。

- 著作権の確認: 生成物が他者の権利を侵害していないか確認するプロセスを設ける。

- 責任の所在: AIが生成したコンテンツの最終的な文責は、AIではなく「公開した人間(企業)」にあることを明記する。

ガイドラインは「作って終わり」ではなく、定期的な研修とセットで現場に浸透させることが不可欠です。

AI時代に企業が取るべき次の一手

要点まとめ:55%の事実と「AIとの協働」

「ネット記事の55%がAI生成」という事実は、もはや避けられない現実です。この変化を「脅威」と捉えて目を背けるか、「変革の好機」と捉えて乗りこなすかで、企業の未来は大きく分かれるでしょう。

重要なのは、AIに「仕事を奪われる」と恐れることでも、AIに「仕事を丸投げ」することでもありません。AIが得意な作業(情報整理、下書き)を任せ、人間は人間にしかできない価値(経験、専門性、信頼性の付与)に集中することです。

「AI vs 人間」ではなく、「AI + 人間」による協働。これこそが、AI時代を生き抜く企業の唯一の正解です。

次のアクション:自社のコンテンツ品質とガイドラインを見直す

この記事を読み終えた今、経営企画部、DX推進部、情シス部、人事部の皆さまが取るべき具体的なアクションは明確です。

- 自社コンテンツの棚卸し: 現在運用しているオウンドメディアや発信情報が、「AI丸投げ」になっていないか? 読者にとって本当に価値のある「経験」や「専門性」が込められているか?を再点検してください。

- AI利用ガイドラインの策定: もしまだ社内ルールが存在しないなら、本日中にでも策定プロジェクトを立ち上げてください。リスク管理は、スピードが命です。

55%という数字は、AIがインフラになった時代の幕開けを告げています。この変化の波に乗り、AIを賢く「使いこなす」企業だけが、次の時代をリードできるのです。

よくある質問(FAQ)

Q1. AIが書いた記事はGoogleからペナルティを受けますか?

A1. 「AIが書いたから」という理由だけで、直ちにペナルティを受けることはありません。Googleが問題視するのは、AI製か人間製かではなく、そのコンテンツが「ユーザーの役に立つか、独自性があるか」です。AIを使っても、独自調査や専門家の知見、具体的な体験談などを加えて高品質な記事に仕上げれば、正しく評価されます。逆に、AIで生成しただけの薄い内容を量産すれば、「Helpful Content Update」の基準に基づき評価が下がる可能性が非常に高いです。

Q2. 社内でAI利用ルールを作る際のポイントは?

A2. 最も重要なポイントは、「機密情報の入力を厳格に禁止すること」と、「AIの生成物を鵜呑みにせず、必ず人間がファクトチェックと編集を行うプロセスを義務化すること」です。また、AIの利用目的を「業務効率化」や「品質向上の補助」と明確に定義し、生成物の著作権侵害リスクや法的責任の所在を明確にしておくことが求められます。

Q3. AIが書いたかどうかをチェックできる無料ツールはありますか?

A3. いくつかの無料または一部無料で試せるAIコンテンツ検出ツールが存在します。例えば、「AI Or Not」や「Crossplag」(無料プランあり)、「Writer」(無料トライアルあり)などが知られています。ただし、これらのツールは100%の精度を保証するものではありません。AI技術の進歩により検出が難しくなっているため、あくまで参考程度とし、最終的にはQ1で述べたような「コンテンツの品質(独自性や経験の有無)」で判断することが重要です。