| この記事でわかること |

|

| この記事の対象者 |

|

| 期待できる効果 |

|

企業のDX推進部、コンテンツ制作部門、そして特にEラーニング・カスタマーサポートの皆様へ。

AIによる音声合成(TTS: Text-to-Speech)技術は進化していますが、特に日本語においては、その「自然さ」と「表現力」の点で、長年の課題を抱えていました。

「合成音声だと、どうしてもイントネーションが不自然で、聴き手が疲れてしまう…」 「感情や強調のニュアンスが表現できず、コンテンツに温かみが感じられない…」 「音声収録にかかる時間、コスト、そしてタレントの手配という壁を乗り越えたい…」

日本語は、同音異義語が多く、文脈や強調する箇所によって意味が大きく変わるため、AIが完璧に処理するのが極めて難しい言語です。

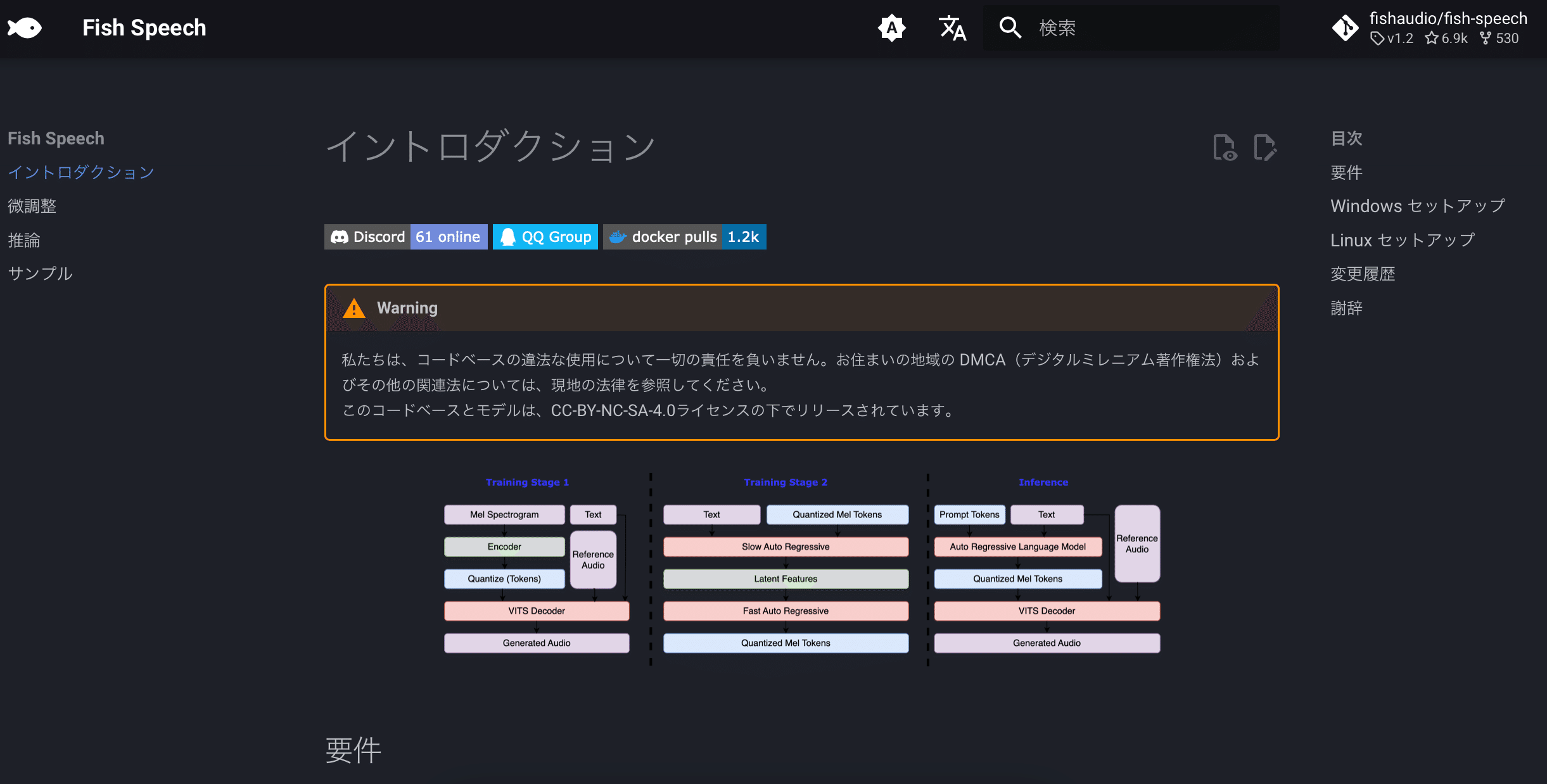

しかし、この「日本語の壁」を打ち破る、革新的なTTSモデル「Fish Speech」が登場しました。このモデルは、完璧な日本語のサポートを標榜し、AI音声の自然さを一段上のレベルに引き上げようとしています。

本稿では、この新しいTTSモデル「Fish Speech」が、日本のコンテンツ制作やサービス提供にもたらす3つの決定的な変革を解説します。AIを活用することで、「低コストで、まるで人間が話しているような」高品質なナレーションを量産し、音声コンテンツの民主化を実現する未来を見ていきましょう。

日本語TTSの難題:なぜ「自然な音声」の実現が困難だったのか?

日本語特有の「イントネーションと文脈」の壁

日本語の音声合成(TTS:Text to Speech)が難しいとされる理由は、その言語特有の構造にあります。

まず挙げられるのが、音の多様性です。日本語には「ピッチアクセント」と呼ばれる高低のアクセントがあり、この違いによって単語の意味が変わります。たとえば「箸」と「橋」は、同じ発音でもアクセントの位置が異なります。AIが文脈に応じてこのアクセントパターンを正確に判断することは容易ではなく、自然なイントネーションを生成する大きな壁となっています。

日本語は文脈依存性が非常に高い言語です。主語が省略されることが多く、AIは文全体や前後の会話の流れから意味を推測し、適切なポーズ(間)や強調をつける必要があります。しかし、従来の音声合成モデルはこの「文脈の理解」が浅いため、結果として「棒読み」や「不自然な区切り」といった違和感が生じやすいという課題がありました。

Fish Speechが克服した「表現力」の限界

Fish Speechのような最新のTTS(Text to Speech)モデルは、深層学習(ディープラーニング)と大規模な日本語音声データを組み合わせることで、これまで日本語音声合成が抱えていた課題を克服しつつあります。

近年のニューラルネットワークの進化により、AIは単にテキストを読み上げるだけでなく、人間の会話に見られるパターンを学習し、「感情」や「強調」といったニュアンスを推論できるようになりました。これにより、文脈に応じた自然なイントネーションやリズムを再現することが可能になっています。

さらに、表現力の向上も大きな進歩の一つです。抑揚や声のトーン、話すスピードなどを細かく調整できる機能が搭載され、「喜び」「怒り」「悲しみ」「冷静さ」などの感情を音声で的確に表現できるようになりました。その結果、AI音声にこれまでにない「温かみ」や「人間らしさ」が生まれ、聴き手のエンゲージメントを高めることができるようになっています。

こうした技術の進化は、「完璧な日本語サポート」の実現が目前に迫っていることを意味します。AIが日本語の複雑な文脈やアクセントのルールを深く理解し、人間の話し方を自然に再現する時代が、すぐそこまで来ているのです。

AI音声合成が切り拓くコンテンツ制作の3つの革命

Fish Speechの登場は、「ナレーションの収録」という従来のクリエイティブプロセスを根本から変革し、ビジネスの様々な領域にメリットをもたらします。

革命1:制作コストの削減とコンテンツの多品種量産

最も直接的な効果は、ナレーション収録にかかるコストと時間の大幅削減です。

- コスト削減: プロの声優やナレーターを起用する際の高額なギャランティや、スタジオ代、編集費といった固定コストが不要になります。

- 多品種量産: 一度AIモデルを構築すれば、テキストさえあれば、何百本もの教育動画やプロモーション動画のナレーションを即座に、かつ一貫した品質で量産できます。

- 事例: Eラーニング教材において、法改正や技術のアップデートがあった際も、該当箇所をテキスト修正するだけで、即座に新しい音声教材を公開できるようになります。

革命2:顧客体験の向上とアクセシビリティの強化

AI音声の自然さが向上することで、サービス提供における顧客体験が向上します。

- オーディオブック・ポッドキャスト: 棒読みではない自然なナレーションにより、オーディオブックやポッドキャストといった音声コンテンツの聴取体験が向上し、ユーザーのエンゲージメントを維持できます。

- アクセシビリティ: ウェブサイトやアプリの音声読み上げ機能に自然なAI音声を活用することで、視覚に障害を持つユーザーや、文字を読むのが苦手なユーザーへのアクセシビリティが大幅に強化されます。

- CSの音声ガイダンス: 電話でのカスタマーサポートにおける自動音声ガイダンスも、自然なAI音声に切り替えることで、顧客の「待たされているストレス」を軽減し、顧客満足度(CSAT)の向上に貢献します。

革命3:「パーソナルな声」の創造とブランドの差別化

AI音声合成技術は、特定のタレントの声を再現するだけでなく、「そのブランドだけのオリジナルの声」を創造することを可能にします。

- ブランドボイスの統一: 企業がブランドのトーン&ボイスに合わせたオリジナルのAI音声を作成し、広告、ウェブサイト、アプリ内通知など、すべての顧客接点で一貫した「声」を提供することで、ブランドイメージの差別化と統一感を生み出します。

AI音声導入における倫理的課題とセキュリティ対策

AI音声技術の進化は魅力的ですが、著作権、肖像権、ディープフェイクといった、倫理的な課題とリスクに細心の注意を払う必要があります。

課題1:声の著作権とディープフェイクのリスク

AIが人間の声の特徴を学習し、再現できるようになったことで、個人の声の著作権や、ディープフェイクによる「なりすまし詐欺」のリスクが高まります。

- 対策:許諾とポリシーの遵守: AI学習に利用する音声データは、必ず本人から明確な許諾を得る。また、AI音声の悪用を防ぐため、ディープフェイク対策技術(生成された音声にウォーターマークを埋め込むなど)を導入することが推奨されます。

- 倫理的ガイドライン: AI音声の利用目的を「不正行為や犯罪を助長する行為に利用しない」など、倫理的ガイドラインを明確に策定し、遵守します。

課題2:感情表現の品質管理と人間の最終確認

AI音声は「人間らしい」表現が可能になりましたが、予期せぬ場面で不自然な感情を表現したり、誤ったイントネーションで意味が伝わりにくくなったりするリスクが残ります。

- 人間の役割: AIが生成したナレーションは、必ず人間の専門家が最終的な品質チェックを行い、ブランドの意図に沿ったトーンであることを確認するハイブリッド体制が必要です。AIの技術(Expertise)を活かしつつ、人間の経験(Experience)で最終的な品質を担保します。

結論:AIが加速させる「音声コンテンツの民主化」

完璧な日本語サポートを標榜する「Fish Speech」のようなTTSモデルの登場は、ナレーション制作のコストと時間の壁を打ち破り、「音声コンテンツの民主化」を加速させます。

AIが「安定した、高品質な音声の量産」という技術的な側面を担うことで、私たちは「コンテンツの企画・構成」という創造性に集中できます。AIを「最強のナレーター」として迎え入れ、あなたの伝えたいメッセージを、より多くの人々に、温かく、そして自然な声で届けていきましょう。

Q&A: AI音声合成とコンテンツ制作に関するよくある質問

Q1. AI音声モデルを選ぶ際、日本語の「自然さ」以外に重視すべき点は何ですか?

「表現力(感情の幅)」と「カスタマイズ性」を重視すべきです。

- 表現力: 喜び、冷静、強調など、求められる感情の幅が広いか。

- カスタマイズ性: 発話スピード、声のトーン、ポーズ(間)の長さを、テキストベースで細かく調整できるか。

これらの機能は、生成された音声が「単なる読み上げ」ではなく、「感情を伝えるナレーション」となるために不可欠です。

Q2. AI音声を使って会社の代表者の声をクローンしても良いですか?

厳格な法的・倫理的な手続きが必要です。代表者の声をAIが学習し、合成音声として利用する場合、「声の著作権・肖像権」に関わるため、代表者本人からの明確かつ書面による許諾(利用範囲、期間、目的を明記)が不可欠です。また、この合成音声がディープフェイクによるなりすまし詐欺に悪用されないよう、セキュリティと利用ポリシーを厳格に管理する体制が求められます。

Q3. EラーニングでのAI音声活用は、学習効果に悪影響を与えませんか?

棒読みの不自然な音声は悪影響を与えるリスクがありますが、Fish Speechのような自然なイントネーションと感情表現が可能なAI音声は、学習効果を損なわないだけでなく、むしろ学習者の集中力やエンゲージメントを高める可能性があります。AI音声の利点は、「必要な時に、必要な情報だけ」を「人間的なトーン」で提供できる、個別最適化された学習体験を提供できる点です。

引用元

X Taiyo | AIで遊ぶ大学生(@taiyo_ai_gakuse)「完璧に日本語をサポートするTTSモデル「Fish Speech」登場」